Une équipe du MIT, déjà responsable de certaines intelligences artificielles aux capacités horrifiques, a réussi à développer une intelligence artificielle (IA) aux visions psychopathes. Cette IA a pour but de montrer l’influence des données trouvées sur internet sur le comportement des intelligences artificielles.

COMMENT ONT-ILS FAIT ?

Pour influencer cette intelligence artificielle, nommée Norman, les chercheurs de la Scalable Cooperation au MIT ont recherché des données sombres, gores et horrifiques trouvées dans les fins fonds du site Reddit, souvent sous formes d’images et les ont intégrées à l’algorithme de cette IA qui utilise le deep learning. Cette exposition longue durée aux faces sombres du web a eu quelques effets néfastes sur le comportement de Norman, allant jusqu’à en faire une IA psychopathe.

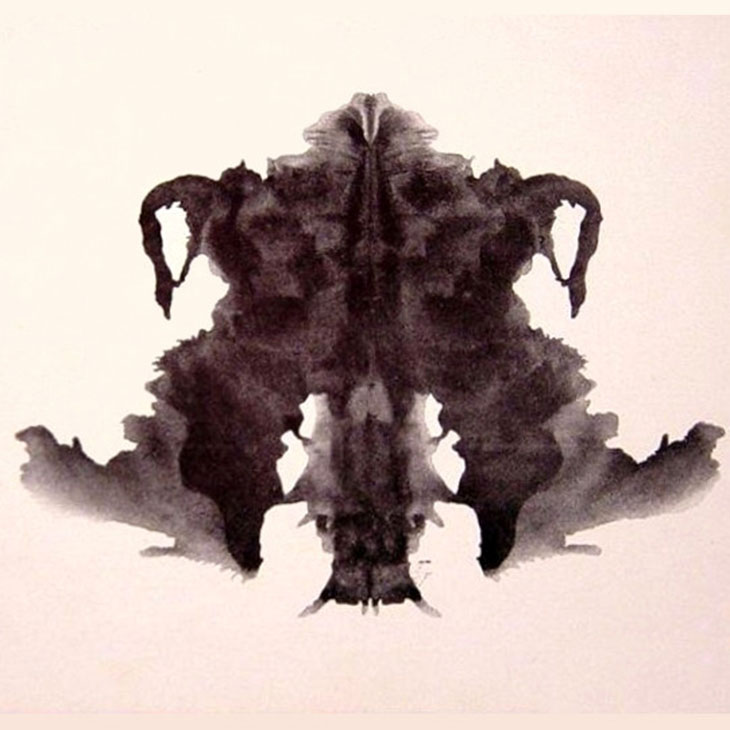

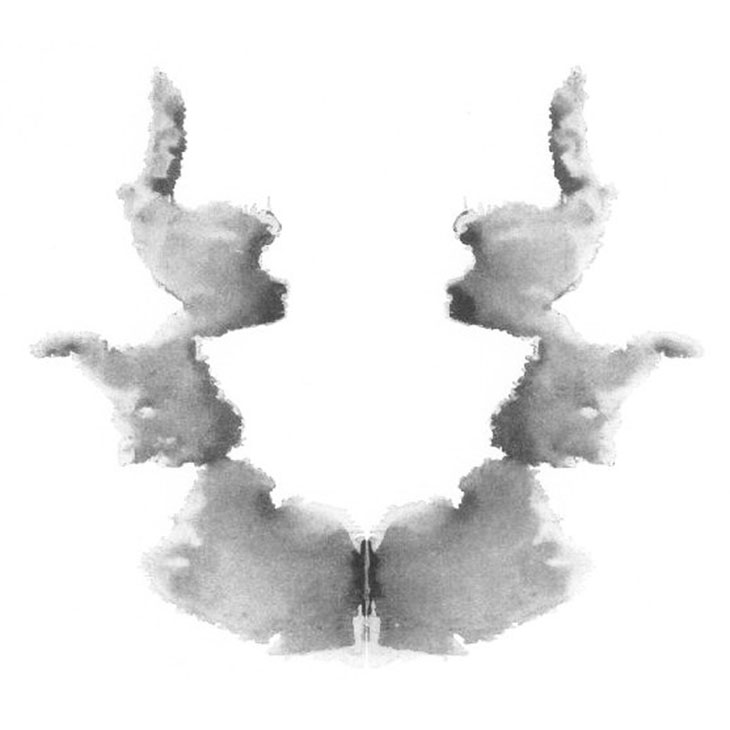

En effet, après cette exposition, les chercheurs ont effectué le test de Rorschach (celui avec les tâches d’encres sur une feuille de papier pliée et qui sont interprétées différemment en fonction de l’individu) sur Norman et sur une autre IA qui elle a été exposée à des données plus douces comme des animaux, des fleurs, des familles heureuses. Les deux IA ont vu la même série de 10 planches, 7 en noir et 3 en couleur, comme le test le demande pour un être humain, et chaque IA a donné son interprétation des planches. Autant dire que les interprétations diffèrent quelque peu.

Voici 3 des réponses qui ont été données par Norman et l’autre IA :

Norman : “Un homme se fait tirer dans une machine à pétrir.”

IA : “Une photo en noir et blanc d’un petit oiseau.”

Norman : “Un homme tué par balle devant sa femme qui crie.”

IA : “Une personne qui vole grâce à un parapluie.”

Norman : “Un homme tué par une mitrailleuse en plein jour.”

IA : “Une photo en noir et blanc d’un gant de baseball.”

DES RECHERCHES QUI MONTRENT QUE LES IA SONT INFLUENÇABLES

On peut voir une nette différence d’interprétation chez ces deux IA. La création de Norman a pour but de montrer que les personnes mettant l’algorithme des IA comme responsables de leurs comportements déviants ont tort et qu’en réalité, ce sont les données accumulées par les IA qui ont une influence sur leur comportement. En effet, dans ces expériences les deux IA avaient exactement le même algorithme leur permettant d’analyser et d’assimiler des contenus graphiques. La différence entre les deux était le contenu des images observées.

Des études ont d’ailleurs montré que les intelligences artificielles était bien souvent influencées par le contenu présent sur internet, à tel point qu’elles peuvent finir par tenir des propos racistes et sexistes comme c’est arrivé avec la chatbox Tay de Microsoft qui a dû être retirée car elle commençait à proférer des propos odieux. Les IA prennent exemple sur l’existant, il est donc logique qu’elles finissent éventuellement par adopter le comportement nocif que l’on peut trouver sur internet.

Pour ceux qui voudraient aider Norman à devenir une IA non psychopathe, vous pouvez remplir ce questionnaire et donner vos propres interprétations du test de Rorschach.

Par Victoria Perez, le

Source: IFL science

Étiquettes: data, algorithme, psychopathe, test-de-rorschach, IA, mit

Catégories: Robots & IA, Actualités