Un détecteur d’intelligence artificielle a récemment affirmé que des textes historiques comme la Déclaration d’Indépendance américaine ou même la Bible provenaient d’une IA. Cette erreur grotesque révèle une faille inquiétante dans notre confiance envers ces technologies.

Pourquoi une IA accuse à tort la Déclaration d’Indépendance d’avoir été écrite par une machine

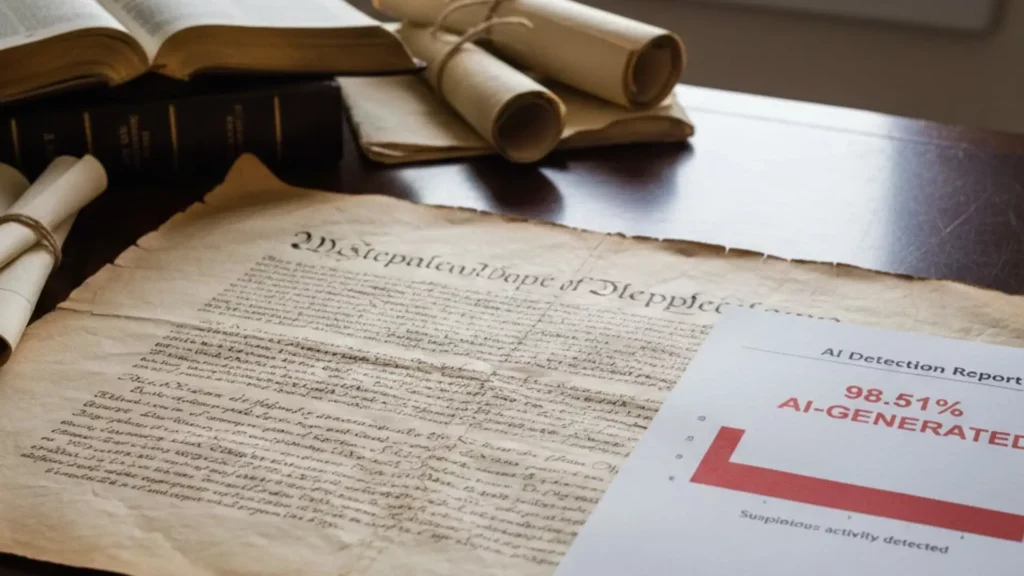

L’information a de quoi surprendre. Une IA a analysé un texte de 1776 et affirmé qu’une autre IA l’avait rédigé. Cet algorithme, censé détecter l’origine des textes, a attribué la Déclaration d’Indépendance américaine à 98,51 % à une machine.

Or, ce texte fondateur des États-Unis date de plusieurs siècles avant l’apparition des ordinateurs. L’erreur, aussi grossière soit-elle, entraîne de vraies conséquences. Cette affaire met en lumière les limites de la fiabilité des détecteurs que l’on intègre déjà dans l’éducation, le journalisme ou la justice.

La Bible, les décisions de justice, les copies d’élèves : ce que les détecteurs d’IA se trompent à reconnaître

D’autres textes sacrés ou historiques — la Bible, certains jugements de tribunaux des années 90 — subissent le même sort. Les outils les qualifient de contenus générés par IA, alors que ces technologies n’existaient même pas à l’époque.

En contestant l’authenticité de textes anciens, ces outils mettent aussi en péril des œuvres plus contemporaines. Ils attribuent à tort certaines copies d’élèves, articles de presse ou manuscrits d’auteurs à des IA. Une telle confusion nuit à des carrières, des réputations et même à des notes scolaires.

Ce problème s’aggrave dans des environnements sensibles comme les plateformes éducatives, les systèmes de vérification académique ou les logiciels de modération. Une détection erronée peut entraîner des sanctions graves, priver d’un recours réel et nourrir une méfiance généralisée envers la technologie.

Écriture humaine ou artificielle : une frontière de plus en plus floue et difficile à tracer

Aujourd’hui, les modèles de langage comme ChatGPT génèrent des textes si crédibles qu’ils brouillent la frontière avec l’écriture humaine. Le véritable enjeu réside dans l’écart entre cette qualité d’imitation et la faiblesse des détecteurs encore bancals.

Autrefois, on reconnaissait un auteur à son encre, à son style, à sa graphie. Aujourd’hui, l’écran uniformise tout. Le style humain devient malléable, facilement imité et manipulé. Une question aussi simple que « ce texte est-il de moi ? » trouve difficilement une réponse claire.

Savoir si un texte est écrit par une IA ou un humain : est-ce vraiment ce qui compte ?

Une chercheuse interrogée sur le sujet soutient que l’important n’est peut-être plus l’auteur, mais le contenu. Selon elle, peu importe qu’un humain ou une machine ait écrit le texte, tant qu’il transmet quelque chose d’utile. Cette idée, à la fois audacieuse et inquiétante, ouvre la voie à de nombreuses dérives.

La propriété intellectuelle, la confiance dans l’information, la valeur symbolique d’un texte dépendent pourtant de son origine. Si l’on brouille cette frontière, que restera-t-il comme repère ? Les temps changent, certes. Mais en laissant les machines contrôler nos récits, nous risquons surtout de perdre nos repères.

bientôt une IA va se demander si un enfant a été conçu par deux êtres humains ou par une IA

Là on va bien rigoler aha aha aha