L’intelligence artificielle dépasse progressivement les capacités humaines et certains chercheurs affirment même qu’elle pourrait un jour remplacer les physiciens. Pourtant, la physique représente un véritable champ d’études pour mieux comprendre l’IA et particulièrement l’apprentissage en profondeur.

L’intelligence artificielle connaît un nouvel essor

La définition exacte de l’intelligence artificielle (IA) reste assez vague. En réalité, lorsqu’on aborde cette discipline, on doit non seulement faire appel à la logique, mais également aux statistiques, aux mathématiques, aux probabilités, à l’informatique et probablement aussi à la neurobiologie dite « computationnelle ». Mais si on pose la question à une personne dont la connaissance se limite au monde réel, la réponse reste souvent la même : l’intelligence artificielle est une machine qui imite la capacité cognitive d’un être humain.

Mais la notion même de l’intelligence connaît des limites dans certains domaines… on a ainsi fini par la qualifier de technologie mise en œuvre dans le but d’appréhender l’apprentissage automatique. L’origine même de l’IA découle d’une théorie effarante, mais totalement fondée : elle provient d’un réseau de neurones artificiels inspiré des couches connectées de neurones des mammifères situées dans leur cortex visuel. On les appelle « réseaux de neurones convolutifs » ou CNN.

Les réseaux de neurones convolutifs ont permis l’apprentissage des images numériques bidimensionnelles, en particulier dans les tâches de vision sur un ordinateur comme le déchiffrage des mots et des objets dans ces images. Les nouvelles techniques d’apprentissage en profondeur résultent alors de cette révolution. Elles ont permis d’explorer l’impossible afin d’aider l’humanité à mieux se porter. Tel est le cas des tumeurs pulmonaires que l’on arrive désormais à détecter facilement grâce au tomodensitogramme. Il en est de même pour les ordinateurs, ils deviennent les maitres d’œuvre, ils sont capables de conduire des véhicules et de mener à la victoire un jeu d’échecs ou de société contre un simple être humain doté d’une grande intelligence.

L’apprentissage automatique se limite uniquement sur des surfaces planaires

Des recherches ont mis en évidence les limites de l’apprentissage automatique lorsqu’on l’applique sur des données qui n’intègrent aucune géométrie planaire. En 2016, on a découvert l’existence d’une discipline d’un tout nouveau genre et qui reste sans doute la réponse aux limites des CNN. L’apprentissage profond géométrique permet aux scientifiques de travailler sur un cadre théorique beaucoup plus vaste où on apprend des modèles sur n’importe quelle surface géométrique.

L’apprentissage profond géométrique provient de la construction des réseaux de neurones convolutifs à jauge. C’est le résultat d’une étude menée par Taco Cohen, Max Welling, Berkay Kicanaoglu et Maurice Weiler à l’université d’Amsterdam et Qualcomm AI Research. Le CNN de jauge permet de détecter des motifs sur des sphères, dans des tableaux 2D de pixels et sur des objets incurvés de façon irrégulière.

Welling a même insisté sur cet argument : « Ce cadre est une réponse assez définitive à ce problème d’apprentissage en profondeur sur des surfaces courbes. » Il faut croire que les CNN de jauge offrent davantage de résultats quand on désire par exemple interpréter les schémas d’apprentissage des données climatiques. Les algorithmes peuvent aussi apporter de l’innovation à la vision des drones et des voitures nouvelle génération. Ils permettent de détecter des motifs même sur des surfaces asymétriquement incurvées d’objets comme les cerveaux ou les cœurs.

En quoi la physique intervient-elle dans l’apprentissage profond ?

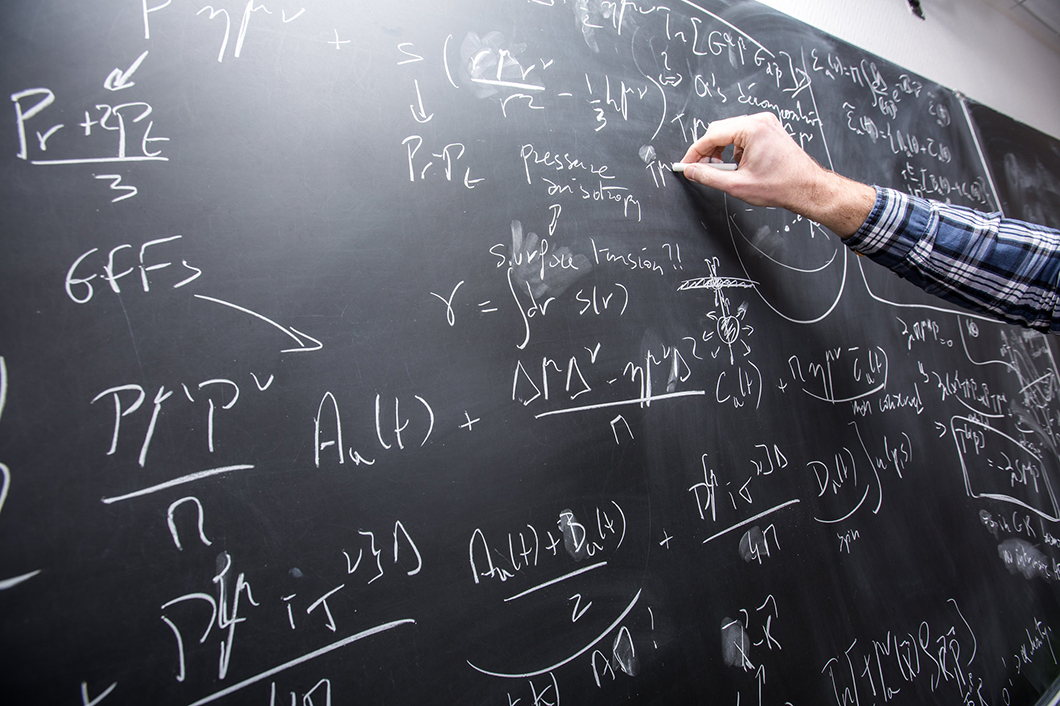

Si l’apprentissage profond peut s’étendre bien au-delà des plaines, la physique y est pour quelque chose. Le monde moderne considère l’intelligence artificielle comme la nouvelle physique qui part d’un même principe d’apprentissage, de raisonnement et d’application. La physique peut se révéler utile pour mieux comprendre l’équivariance de jauge.

Il faut remonter plus haut vers la théorie d’Albert Einstein pour parvenir à saisir le sens. Certes, la réponse se trouve dans l’apprentissage et la compréhension de la physique des particules. Il s’avère que cette loi comporte une équivariance de jauge. Cette propriété veut nous éclairer sur certains aspects de l’univers et démontre que les quantités de particules ainsi que leurs relations ne dépendent pas des jauges ou des référentiels arbitraires.

Prenons simplement l’exemple d’un terrain de foot que l’on mesure en yards puis en mètres. Les mesures prises ne donnent pas les mêmes chiffres. Cela signifie que les physiciens gardent toujours une certaine cohérence dans les modèles de réalité, peu importe l’unité de mesure ou l’angle de vue lors d’une prise de photo. Il en est de même pour les CNN de jauge. Ils adoptent la même hypothèse que les physiciens.

L’apprentissage profond géométrique inventé en 2015 par l’informaticien de l’Imperial College de Londres, Michael Bronstein, vise à concevoir des réseaux de neurones efficaces pour sortir des plaines et apprendre des modèles sur des surfaces non planes. Cet effort a incité un grand nombre de chercheurs à progresser dans la conception des réseaux de neurones pour les images 2D et c’est de là que le terme « convolution » est né. En principe, une couche de ce réseau effectue un calcul mathématique sur des mini-correctifs des données d’entrée. Il transmet ensuite les résultats à la couche suivante puis à une autre et ainsi de suite.

Selon Bronstein : « La convolution est comme une fenêtre coulissante. » Le réseau de neurones convolutifs va filtrer plusieurs de ces fenêtres sur les données. Elles sont conçues dans le but de localiser un motif spécifique dans les schémas. Mais soyons tout de même logiques, la convolution utilisée sur une surface irrégulière reste moins évidente. Qu’importent les méthodes appliquées, il existera toujours des distorsions.

Pour résoudre les problèmes liés au plan non euclidien, l’informaticien et son équipe ont découvert en 2015 une autre alternative aux fenêtres coulissantes. Il s’agit d’un objet qui s’apparente beaucoup plus à une toile d’araignée circulaire qu’à un carré de papier millimétré qu’on utilise pour dessiner par exemple la bordure du Groenland. Avec cette toile d’araignée, on arrive à l’appuyer contre le globe sans la déformer ni la déchirer, ni même la froisser. Les propriétés du filtre étant modifiées, le CNN pourrait alors déchiffrer des relations géométriques importantes. Mais où toutes ces études peuvent nous mener ?

Un réseau convolutif permet d’obtenir une bonne base d’information sur différentes orientations. Toutes ces hypothèses liées aux symétries géométriques ont permis à Cohen et Marysia Winkels d’apporter de meilleurs résultats d’un diagnostic de cancer pulmonaire dans les tomodensitogrammes. En 2017, les chercheurs se sont appuyés sur le réseau convolutif standard pour repérer les cyclones avec une grande précision. L’année suivante, cette précision a augmenté de 97,9 %.

Bref, l’apprentissage automatique et la physique sont deux domaines indissociables. Combinés, ils peuvent mener l’intelligence artificielle vers des dimensions encore plus élevées.